Descubre qué son la CPU, GPU, NPU, SoC, TPU y FPGA, para qué sirve cada una y en qué se diferencian. Guía clara para no técnicos.

Contenidos mostrar

Qué es una CPU, una GPU y una NPU: guía para entenderlo sin ser técnico

Hace no demasiado tiempo, cuando alguien hablaba del procesador de un ordenador, la conversación era sencilla: CPU, gigahercios, núcleos. Punto. Hoy, en cambio, abres cualquier noticia de tecnología y aparecen siglas por todas partes — GPU, NPU, TPU, FPGA, SoC — y cada fabricante parece tener prisa por añadir una más a la lista.

No es casualidad. La irrupción de la inteligencia artificial en los dispositivos de consumo ha acelerado una tendencia que llevaba años gestándose en laboratorios e industria: la especialización del hardware. Ya no basta con un procesador que haga de todo más o menos bien. Hoy los chips se diseñan para tareas concretas, y entender para qué sirve cada uno se ha vuelto útil incluso si no eres técnico.

Este artículo no asume conocimientos previos. Si alguna vez te has preguntado qué diferencia hay entre la CPU y la GPU de tu ordenador, qué hace exactamente esa NPU que mencionan en los anuncios de los nuevos portátiles, o qué es esa TPU que aparece en las noticias sobre Google y la IA, aquí tienes las respuestas — sin fórmulas, sin jerga innecesaria, con ejemplos del mundo real.

Cómo elegir el procesador AMD adecuado para ti

CPU: el procesador que lo hace todo

La CPU, o Unidad Central de Procesamiento, es el chip principal de cualquier ordenador o dispositivo: el encargado de ejecutar las instrucciones de los programas, gestionar el sistema operativo y coordinar el resto del hardware. Es, en esencia, el cerebro del equipo.

Su gran fortaleza no es la velocidad bruta en una tarea específica, sino la versatilidad. Una CPU puede calcular la física de un videojuego, compilar código, procesar una hoja de cálculo y gestionar las conexiones de red al mismo tiempo, porque está diseñada para manejar todo tipo de instrucciones, incluso las más complejas y variadas. Para eso, sus núcleos son relativamente pocos — entre 4 y 24 en procesadores de consumo habitual — pero cada uno es muy potente y capaz de resolver problemas lógicos elaborados en secuencia.

En el mercado de consumo, el sector está dominado por dos fabricantes: Intel, con su familia Core (i3, i5, i7, i9, y más recientemente la serie Core Ultra), y AMD, con los procesadores Ryzen (Ryzen 3, 5, 7 y 9). Ambas marcas se encuentran en la mayoría de los ordenadores de sobremesa y portátiles del mercado, y sus generaciones más recientes ya incorporan, junto a la CPU tradicional, otros tipos de unidades de procesamiento integradas — algo sobre lo que volveremos más adelante.

Conviene detenerse un momento en un término que AMD usa con frecuencia: APU, o Accelerated Processing Unit. En la práctica, una APU es simplemente una CPU que integra una GPU en el mismo chip, sin necesidad de tarjeta gráfica dedicada. AMD acuñó este nombre para distinguir sus procesadores con gráficos integrados — como los Ryzen G, presentes en muchos equipos de gama media y en consolas como la PlayStation y Xbox — de aquellos modelos que no los incluyen. Intel hace lo mismo con sus procesadores, pero nunca adoptó esa denominación. Si alguna vez ves las siglas APU en una ficha técnica o en una noticia, ya sabes que estás ante un procesador con gráficos incorporados listo para funcionar sin tarjeta dedicada.

Vale la pena mencionar también los chips Apple Silicon — la serie M de Apple, presente en los Mac desde finales de 2020. Técnicamente no son solo una CPU, sino un SoC completo que integra varios tipos de procesadores en un único chip. Son un buen ejemplo de hacia dónde se mueve la industria, y los veremos con más detalle en su propia sección.

La CPU sigue siendo imprescindible en cualquier dispositivo. Puede que no sea la más rápida renderizando gráficos ni la más eficiente ejecutando modelos de IA, pero ningún otro chip la reemplaza cuando se trata de coordinar todo lo demás.

GPU: de los videojuegos a la inteligencia artificial

La GPU, o Unidad de Procesamiento Gráfico, es el chip especializado en procesar imágenes, vídeo y gráficos en tiempo real. Nació para hacer una cosa muy concreta: mover millones de píxeles por segundo sin que la imagen se rompa ni se ralentice. Y para eso desarrolló una arquitectura radicalmente distinta a la de la CPU.

Donde una CPU tiene pocos núcleos muy potentes, una GPU tiene miles de núcleos pequeños trabajando en paralelo. Esa diferencia no es un detalle técnico menor — es la razón por la que una GPU puede renderizar una escena 3D compleja en milisegundos, y también la razón por la que, décadas después de su invención, se convirtió en el hardware favorito para entrenar modelos de inteligencia artificial. El entrenamiento de una red neuronal, en el fondo, consiste en hacer millones de cálculos matemáticos simples al mismo tiempo. La arquitectura paralela de la GPU encajaba perfectamente con ese problema.

Hoy la GPU tiene dos grandes roles. El primero, el original: gaming, edición de vídeo, diseño 3D, renderizado. El segundo, mucho más reciente y cada vez más relevante: acelerar cargas de trabajo de inteligencia artificial, tanto en centros de datos como, en menor medida, en los propios ordenadores de los usuarios.

En el mercado de consumo, las tres marcas principales son NVIDIA (serie GeForce RTX), AMD (Radeon RX) e Intel (Arc). NVIDIA domina ampliamente el segmento gracias en parte a su ecosistema CUDA, que se convirtió en el estándar de facto para desarrollo de IA. Fuera del consumo, sus tarjetas profesionales — la H100, la B200 — son las que alimentan los grandes modelos de lenguaje y los servicios de IA en la nube, aunque a precios y escalas que no tienen nada que ver con el mercado doméstico.

Una distinción que conviene tener clara: la GPU de un portátil de gama media no entrena modelos de IA. Lo que hace es acelerar ciertas tareas locales — efectos en videollamadas, upscaling de imagen, algunas funciones creativas — mientras que el entrenamiento real de los grandes modelos ocurre en centros de datos con decenas o cientos de GPUs trabajando en conjunto. Son el mismo tipo de chip, pero a escalas completamente distintas.

NPU: la IA que ya llevas en el bolsillo

La NPU, o Unidad de Procesamiento Neural, es un chip diseñado específicamente para ejecutar operaciones de inteligencia artificial de forma rápida y eficiente directamente en el dispositivo, sin necesidad de enviar datos a la nube. No entrena modelos — eso sigue ocurriendo en grandes centros de datos con GPUs — sino que los ejecuta: toma un modelo ya entrenado y lo corre localmente, con muy poco consumo de energía.

¿Por qué hace falta un chip dedicado para eso? Porque las operaciones que requiere una red neuronal — multiplicaciones de matrices, operaciones tensoriales — son muy repetitivas y predecibles. Una CPU puede hacerlas, pero gasta más energía de la necesaria y ocupa recursos que podrían estar haciendo otra cosa. Una NPU está construida exactamente para ese tipo de cálculo, nada más, y lo hace de forma mucho más eficiente.

En la práctica, la NPU es la responsable de muchas de las funciones que hoy damos por sentadas en teléfonos y portátiles modernos:

- Reconocimiento facial para desbloquear el dispositivo

- Transcripción de voz en tiempo real

- Traducción automática sin conexión

- Efectos de cámara inteligentes (desenfoque de fondo, mejora de iluminación)

- Funciones de IA generativa local, como las de Copilot+ en Windows

Esta última categoría es especialmente relevante. Microsoft exige un mínimo de 40 TOPS (billones de operaciones por segundo) para que un portátil sea compatible con Copilot+, y ese requisito apunta directamente a la NPU. Los procesadores que ya la incorporan incluyen el Intel Core Ultra (series 100 y 200), los AMD Ryzen AI, los chips Apple Silicon desde el M1 en adelante, y los Qualcomm Snapdragon X presentes en muchos portátiles con Windows on ARM.

Lo interesante es que la mayoría de los usuarios ya tiene una NPU sin saberlo. Está integrada dentro del mismo chip que contiene la CPU, funcionando en segundo plano cada vez que el sistema detecta una tarea que puede beneficiarse de ella. No es un componente que se vea ni se compre por separado — simplemente está ahí, haciendo su trabajo sin llamar la atención.

SoC: cuando todo el procesador cabe en un chip

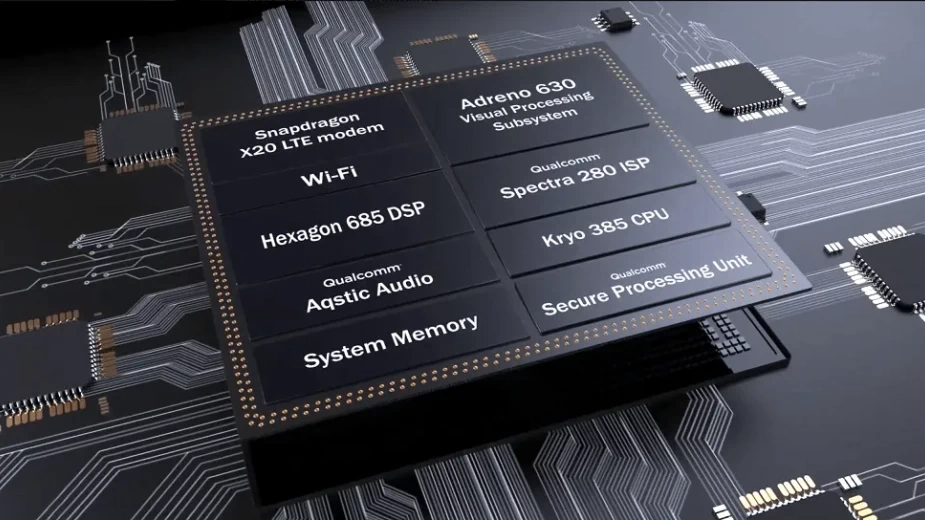

Un SoC, o System on a Chip, es un circuito integrado que reúne en un único chip varios componentes que en un ordenador tradicional estarían separados: la CPU, la GPU, la NPU, la memoria y otros controladores. En lugar de tener distintos chips comunicándose entre sí a través de la placa base, todo convive en el mismo silicio.

La ventaja principal no es solo el tamaño — que también — sino la eficiencia. Cuando CPU, GPU y NPU comparten el mismo chip y, en muchos casos, el mismo banco de memoria, el intercambio de datos entre ellas es mucho más rápido y consume mucha menos energía que si estuvieran en chips separados. Eso se traduce en dispositivos más delgados, con mejor autonomía y menor generación de calor.

El SoC es la arquitectura dominante en prácticamente todos los teléfonos móviles del mundo. Cuando escuchas hablar del Snapdragon 8 Elite en un Android de gama alta, del Apple A18 en un iPhone o del Dimensity 9400 de MediaTek, todos son SoCs. Cada uno integra su propia CPU, GPU, NPU y otros componentes especializados en un paquete compacto diseñado para funcionar con una batería pequeña durante todo el día.

Pero los SoCs han dejado de ser exclusivos de los móviles. Los chips Apple Silicon — la serie M que equipa los Mac desde 2020 — son quizás el ejemplo más conocido de SoC en ordenadores de escritorio y portátiles. El M4, por ejemplo, integra una CPU de hasta 10 núcleos, una GPU de hasta 10 núcleos, una NPU capaz de 38 TOPS y memoria unificada compartida entre todos ellos. El resultado es un rendimiento por vatio difícil de igualar con arquitecturas tradicionales. Los nuevos portátiles con Qualcomm Snapdragon X Elite siguen una filosofía similar, y tanto Intel como AMD están moviendo sus diseños en esa misma dirección con sus últimas generaciones.

Para el usuario de consumo, la implicación práctica es sencilla: si tienes un móvil fabricado en los últimos cinco años, ya usas un SoC. Y si compras un portátil hoy, es muy probable que su procesador ya integre CPU, GPU y NPU en el mismo chip, aunque el fabricante no siempre lo mencione con ese nombre.

TPU: el superprocesador de IA que trabaja entre bastidores

La TPU, o Tensor Processing Unit, es un chip diseñado por Google específicamente para acelerar los cálculos matemáticos que requiere el entrenamiento y la ejecución de modelos de inteligencia artificial a gran escala. La primera versión llegó en 2016, desarrollada internamente para los centros de datos de Google, y desde entonces ha evolucionado hasta convertirse en uno de los pilares de la infraestructura de IA más grande del mundo.

Para entender qué la distingue de una GPU, hay que entender qué es un ASIC. Un ASIC (Application-Specific Integrated Circuit) es un chip diseñado para hacer una única cosa con la máxima eficiencia posible, eliminando la complejidad innecesaria de los chips de propósito general. Una GPU es versátil: sirve para gaming, para edición de vídeo, para IA. Una TPU no tiene esa versatilidad — está optimizada exclusivamente para operaciones tensoriales y matriciales, que son el núcleo matemático del aprendizaje profundo. A cambio, las hace con una eficiencia energética y una velocidad que las GPUs de propósito general no pueden igualar a igual escala.

La TPU no es hardware de consumo. No la encontrarás en ningún ordenador doméstico, ni existe versión para gaming ni para portátiles. Vive en los centros de datos de Google y se utiliza para entrenar y ejecutar los modelos más exigentes: Gemini, las versiones anteriores de Bard, Google Translate, los sistemas de reconocimiento de imagen de Google Fotos y buena parte de la infraestructura de búsqueda con IA.

Dicho esto, cualquier persona que use servicios de Google está usando los resultados de una TPU sin saberlo. Cuando Google Translate procesa un párrafo en segundos, cuando Gemini responde a una pregunta compleja o cuando Google Fotos identifica caras y paisajes en miles de imágenes, hay TPUs trabajando en segundo plano. Son invisibles para el usuario final, pero forman parte de la infraestructura que hace posible la IA tal como la conocemos hoy.

FPGA: el chip que se reprograma a sí mismo

Una FPGA, o Field-Programmable Gate Array, es un chip cuya función no viene determinada de fábrica, sino que puede reconfigurarse después de su fabricación para comportarse como el circuito digital que el programador necesite. Es, en cierto sentido, hardware moldeable: en lugar de comprar un chip especializado para una tarea concreta, compras un chip que puedes convertir en ese especialista.

La diferencia con todos los chips que hemos visto hasta ahora es fundamental. Una CPU, una GPU o una NPU hacen lo que hacen porque sus circuitos están grabados de forma permanente en el silicio. Una FPGA, en cambio, contiene una matriz de bloques lógicos reconfigurables que se pueden conectar entre sí de distintas maneras mediante software. Cambias la configuración y, en la práctica, tienes un chip diferente. Esto la hace extraordinariamente útil en contextos donde se necesita procesamiento paralelo a medida, baja latencia y eficiencia energética para una tarea muy específica — pero donde esa tarea puede cambiar o necesita ajustarse.

Sus aplicaciones reales quedan lejos del usuario doméstico:

- Equipos de telecomunicaciones y procesado de señal en tiempo real

- Sistemas de red de alta velocidad (routers y switches de gama profesional)

- Investigación académica y prototipado de nuevos chips

- Sistemas industriales y aeroespaciales donde la fiabilidad es crítica

- Trading algorítmico de alta frecuencia, donde cada microsegundo cuenta

El motivo por el que casi ningún usuario de consumo trabaja con FPGAs es sencillo: programarlas es complejo. No se programan con Python ni con C — requieren lenguajes de descripción de hardware como VHDL o Verilog, que describen el comportamiento de circuitos electrónicos, no de software. Es una disciplina próxima a la ingeniería electrónica, no a la programación convencional.

Para el lector de este artículo, lo importante es saber que las FPGAs existen, que hacen cosas que ningún otro chip puede replicar exactamente de la misma forma, y que probablemente están presentes en algún equipo de la infraestructura que usa a diario — aunque nunca las vea ni interactúe con ellas directamente.

Tabla comparativa

| CPU | GPU | NPU | SoC | TPU | FPGA | |

|---|---|---|---|---|---|---|

| Qué es | Procesador general | Procesador gráfico y paralelo | Procesador para IA local | Chip que integra varios procesadores | Procesador de IA para centros de datos | Chip de hardware reconfigurable |

| Diseñado para | Todo tipo de tareas | Gráficos, vídeo, IA | Ejecutar modelos de IA en local | Eficiencia integrada en móviles y portátiles | Entrenar y ejecutar IA a gran escala | Tareas específicas y personalizables |

| Núcleos | Pocos, muy potentes | Miles, pequeños y paralelos | Dedicados a redes neuronales | Combinación de los anteriores | Optimizados para operaciones tensoriales | Bloques lógicos reconfigurables |

| ¿Hardware de consumo? | Sí | Sí | Sí (integrado) | Sí | No | Raramente |

| Dónde lo encuentras | Cualquier PC o portátil | PC gaming, estaciones de trabajo | Dentro de CPU o SoC modernos | Móviles, portátiles compactos | Centros de datos de Google | Industria, telecomunicaciones, investigación |

| Marcas principales | Intel, AMD, Apple | NVIDIA, AMD, Intel | Intel, AMD, Apple, Qualcomm | Apple, Qualcomm, MediaTek | Google (uso interno) | Xilinx (AMD), Intel |

| Consume energía | Media | Alta | Muy baja | Baja-media (optimizado) | Alta (a escala de datacenter) | Variable |

El hardware que no ves, pero que ya usas

Durante años, hablar de procesadores era hablar de una sola cosa: la CPU. El resto era ruido de fondo para especialistas. Hoy ese mapa ha cambiado por completo, y la razón principal tiene nombre: inteligencia artificial.

La IA no cabe en un solo tipo de chip. Entrenarla necesita las GPUs masivas de los centros de datos. Ejecutarla en tu teléfono o portátil necesita una NPU eficiente. Hacerla funcionar a la escala de Google necesita TPUs. Y todo eso, en los dispositivos modernos, tiende a converger en un único SoC donde cada pieza ocupa exactamente el espacio que le corresponde.

Lo que hace interesante este momento no es la complejidad — es el resultado. El usuario que desbloquea el móvil con la cara, dicta un mensaje de voz mientras conduce o usa un filtro de cámara en tiempo real no está pensando en chips. Está usando tecnología que, hace apenas diez años, habría requerido un servidor. El hardware se ha vuelto invisible precisamente porque ha funcionado. Y entender, aunque sea a grandes rasgos, qué hay detrás de esa magia, es la mejor forma de leer con criterio todo lo que viene después.